tp钱包app安卓版下载

tokenlm官网,token imdownload

3 高效训练能力,支持序列并行,能够快速处理超长 token 的训练任务序列并行技术的加入显著提高了训练效率,使得大规模任务的完成变得更加容易4 支持多模态 MLLM 模型微调,结合 InternLM2 的强大功能,XTuner 提供了从预训练到微调的完整支持,尤其在视觉场景下的表现优异对于视觉编码器 ViT 的;Equilibrium于2021年完成250万美元融资,由KR 1Signum Capital和Hypersphere Ventures等机构参与投资计划于3月8日至9日在Gateio进行首发,出售625万个Token,单价0008美元Your Open MetaverseYOM官方网站yomooo 简介YOM是一个点对点的元宇宙基础设施,允许创作者从自己的站点部署和控制自。

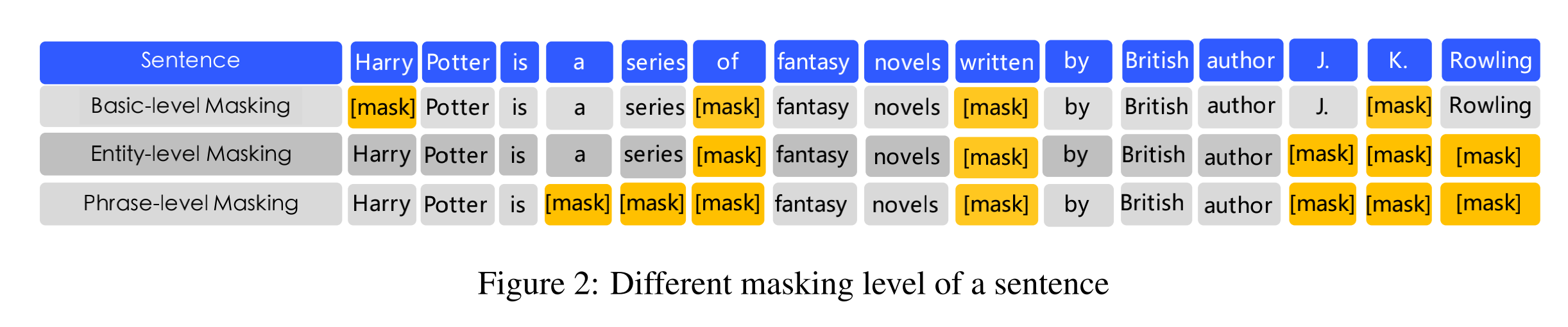

Toolformer是一个经过特殊训练的模型,其核心能力在于决定调用哪些API何时调用以及传递哪些参数,并将其结果整合进未来token预测中这一过程通过自监督学习完成,仅需为每种API演示少量实例即可论文提出了一种基于大型LM和上下文学习的创新方法,通过编写关于如何使用API的人工示例,让LM自动标注大规模语言;掩码操作以token为单位,利用WordPiece进行分词,确保全词掩码模式下的整体性,无论是全掩码还是全不掩码每个序列以masked_lm_prob015概率进行掩码,对于被掩码的token,80%情况下替换为MASK,10%保持不变,10%则替换为词表中随机选择的单词返回结果包括掩码操作后的序列掩码token索引及真实。

tokeninsight官网

在训练过程中,随机mask一部分token,利用上下文信息预测被mask的token,使得模型考虑token的上下文信息,提高模型对语言上下文和流程的感知能力Masked LMMLM是BERT的关键技术,通过将要预测的词遮挡起来,借助attention机制获得预测词的上下文信息,同时避免模型直接从输入中复制答案在训练过程中,随机mask。

在LMDrive中,LLM充当整个驾驶过程的“大脑”,处理由视觉编码器生成的每一帧的传感器token,理解自然语言指令,生成必要的控制信号,并预测指令是否完成LLaMA作为语言主干,与三个相关组件标记器QFormer和两个适配器一起工作,将指令和可视化token化,处理视觉信息,预测动作标记,并应用PID控制器。

tokenview官网

1、当然这里也可以使用LMDeploy的模型部署服务,其支持开箱即用的命令行对话Gradio Demo展示和Api服务,思路主要如下其会在同路径下生成一个workspace 文件夹,随后就可以直接进行对话了命令行对话lmdeploy chat turbomind workspaceGradio Demolmdeploy serve gradio workspace API服务关于模型。

2、个 token 的 vocabulary 词嵌入 31 Pretraining BERT 我们不使用传统的从左到右或从右到左的语言模型来预训练BERT相反,我们使用本节所述的两个无监督任务对BERT进行预训练这一步如图1的左半部分所示 Task #1 Masked LM 标准的语言模型只能实现从左到右或从右到左的训练。

3、我们可以在论文 Attention 电脑 Augmented Convolutional Networks 中找到第一个使用的记录,这篇论文试图结合自注意力机制和卷积摆脱卷积主要是由于 CNN 引入的空间归纳偏置另一个例子见于论文Visual Transformers Tokenbased Image Representation and Processing for Computer Vision,这篇论文在基于滤波器的 token。

4、默认破解模式 Singlewordlistincremental 主配置文件中指定默认wordlist 破解Linux系统账号密码 破解windows密码 Johnny 图形化界面的john 5 ophcrack 简介 基于彩虹表的LMNTLM密码破解软件 彩虹表php 已赞过 已踩过lt 你对这个回答的评价是? 评论 收起 为。

5、Attention模块之所以特殊,是因为在计算过程中,每个token的查询query需要与同一sequence中其他token的键key和值value进行交互计算,存在内在依赖性因此,在进行CP并行时,计算开始前需要通过allgather通信手段获取所有token的KV向量,反向计算时则通过reduce_scatter分发gradient梯度为了降低显存使用,前。

6、BERT的工作原理类似于深度学习模型在ImageNet上的应用首先,在大规模语料库上使用Masked LM任务训练BERT,然后通过添加额外层进行微调以执行特定任务,如分类或问答例如,使用BERT在如Wikipedia这样的语料库上进行训练,然后根据自定义数据微调模型执行分类任务关键在于,分类时仅使用CLS token的输出。

7、TokenPacker Efficient Visual Projector for Multimodal LLM 针对MLLM连接器的设计,文章采用与Cambrian1相似的方法,即先对齐不同尺度的视觉特征,使用交叉注意力融合,降低视觉令牌数量实验设置遵循通用原则,旨在优化连接器模型的性能基准和设置InternLMXComposer25 A Versatile Large Vision。

8、为了进一步提升解码过程的效率与质量,美杜莎引入了树状注意力机制Tree Attention Mechanism通过构建树状结构,将LM语言模型头的输出作为根节点,各个解码头的预测作为子节点,形成了一个多层次的候选路径网络这种结构不仅能够减少搜索空间,还使得在Topk候选集中,通过稀疏化管理,高效地在前10个。

9、Groq,一个在人工智能领域掀起波澜的技术平台,通过其创新的硬件设计语言处理单元LPUs,在语言模型LM的推理速度上取得了显著突破,展示了令人瞩目的速度提升本文将深入探讨Groq的技术优势对各行业的影响及其对人工智能未来的潜在变革在计算密集型的语言任务中,Groq的LPUs展现出卓越的效率。